Qu’est-ce qu’un LLM qui raisonne ?

🧠 Les LLM qui raisonnent : quand les intelligences artificielles commencent à réfléchir (presque) comme nous

Tu as peut-être déjà entendu parler des LLM, ces fameux modèles de langage comme ChatGPT, Gemini ou Claude. Ils sont capables d’écrire des textes, répondre à tes questions, t’aider à rédiger des mails (ou les éviter)… Mais depuis quelque temps, on parle d’une nouvelle génération de ces modèles : les LLM qui “raisonnent”. Et là, ça devient vraiment intéressant.

Mais… qu’est-ce que ça veut dire raisonner pour une intelligence artificielle ? Spoiler : non, elle ne se fait pas des nœuds au cerveau, car elle n’a pas de cerveau.

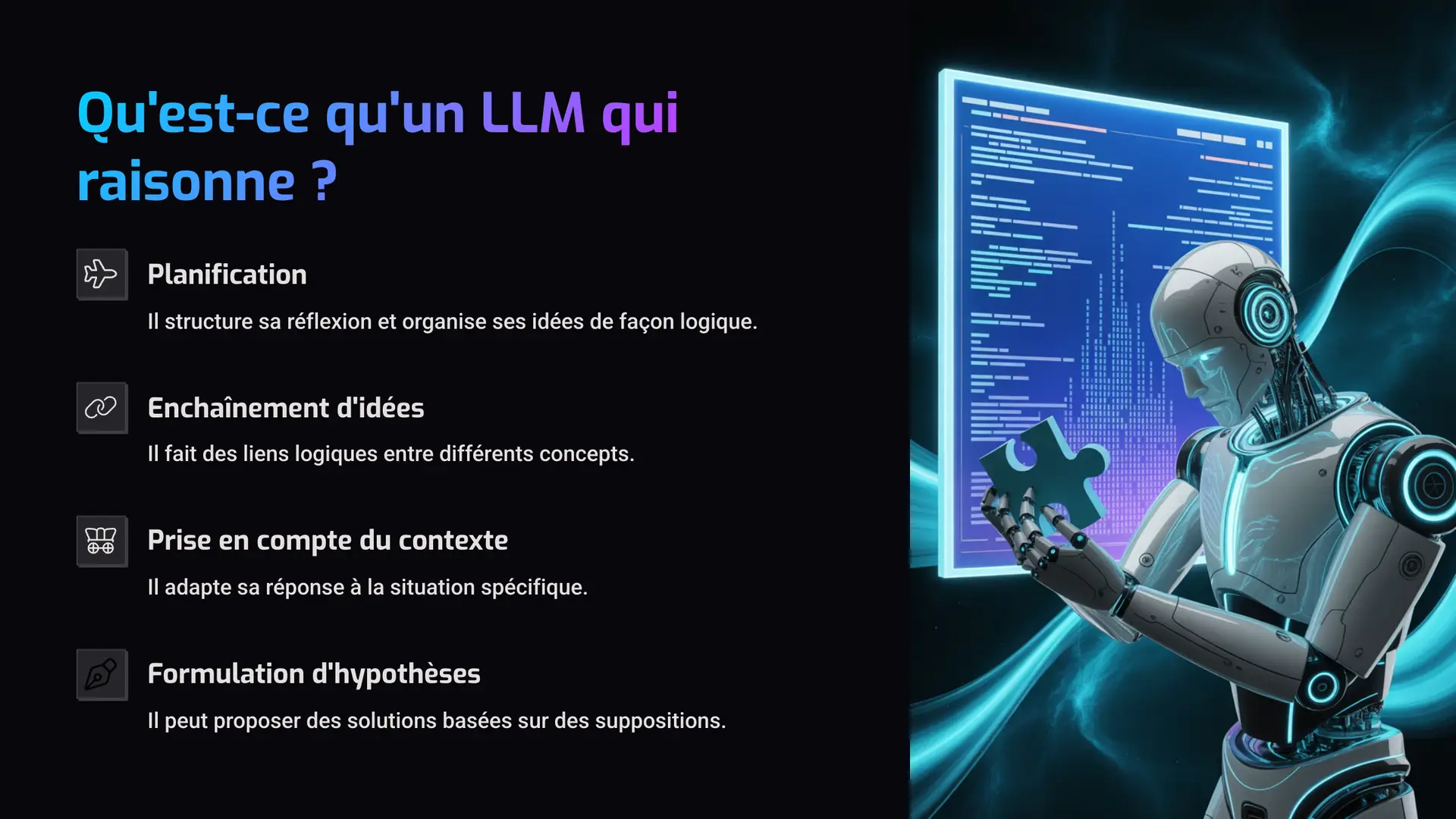

🧠 Alors c’est quoi, un LLM qui raisonne ?

Un LLM qui raisonne, c’est un modèle qui ne se contente plus de recracher des probabilités de mots. Il planifie, enchaîne des idées, fait des liens logiques, prend en compte le contexte et parfois même pose des hypothèses. En gros, il essaie de penser comme un humain… mais sans émotions, sans café et sans procrastination (chanceux, hein ?).

Exemples de raisonnement qu’un LLM peut tenter :

Résoudre une énigme mathématique étape par étape 🧮

Trouver une solution créative à un problème donné 🧩

Réfuter une affirmation avec des arguments logiques ⚖️

Générer un plan d’action ou un scénario cohérent 📋

🧪 Mais… comment il fait ça, concrètement ?

On va simplifier (sinon on part sur un article de thèse 😅) :

Prompting malin : On apprend au modèle à “penser à voix haute” (chain-of-thought prompting). Plutôt que de lui dire “donne-moi la réponse directe”, on lui dit “explique ton raisonnement”. Et il le fait. Parfois très bien.

Entraînement spécial : Les modèles qui raisonnent bien sont souvent entraînés avec des données qui contiennent des chaînes de raisonnement, comme des solutions d’exercices, des discussions logiques, ou des jeux de rôle avec Sherlock Holmes. 🕵️

Mémoire & outils : Certains LLMs peuvent aussi utiliser une mémoire externe ou des outils (calculatrice, moteur de recherche…) pour mieux structurer leur réflexion.

🤖 Mais alors, ils pensent vraiment comme nous ?

Pas tout à fait. Même si ça en donne l’illusion, un LLM ne comprend pas vraiment ce qu’il dit. Il simule un raisonnement à partir de modèles statistiques, mais il ne “sait” pas. Il n’a pas de conscience, pas d’intuition, et encore moins d’envie d’aller faire un tour en forêt pour “réfléchir”.

On pourrait dire que :

Un LLM ne pense pas. Il fait comme si il pensait.

Et parfois, ce “comme si” est bluffant. Mais parfois, ça donne aussi des réponses complètement à côté de la plaque, dites hallucinations. Un peu comme ton pote qui improvise en contrôle d’histoire.

🤔 Pourquoi c’est important ?

Parce que si un modèle peut raisonner :

Il peut mieux t’aider à résoudre des problèmes complexes.

Il peut interagir avec des systèmes, prendre des décisions, t’expliquer pourquoi.

Il devient plus utile, mais aussi plus risqué s’il se trompe avec assurance.

C’est pourquoi on garde un œil attentif sur ces modèles “intelligents” : le pouvoir de raisonner, c’est aussi le pouvoir de se planter avec style.

🧵 En résumé

| 🤓 LLM Classique | 🧠 LLM qui Raisonne |

|---|---|

| Prédit le mot suivant | Enchaîne des idées logiques |

| Très bon à l’imitation | Capable d’argumenter |

| Réponse rapide | Réponse réfléchie (parfois) |

| Ne pense pas | Ne pense toujours pas, mais fait semblant super bien |

🗣️ Le mot de la fin

Les LLM qui raisonnent ne sont pas des philosophes en puissance, mais ils s’en rapprochent par moments. C’est fascinant, utile, mais à manier avec prudence.

Et qui sait ? Peut-être qu’un jour, ces IA n’auront pas seulement des idées… mais aussi une opinion sur les meilleures pizzas. 🍕

💡 Des questions, des remarques, ou juste envie de papoter IA ? On ne mord pas (sauf les robots affamés). Rejoins-nous ici